Các trung tâm dữ liệu AI hiện tại phải đối mặt với hai điểm nghẽn cốt lõi trong việc mở rộng quy mô và các mô hình-mở rộng và mở rộng quy mô{1}}truyền thống đang gặp khó khăn trong việc đáp ứng nhu cầu AI ở quy mô lớn-giga:

Giới hạn về quy mô{0}}Tăng lên: Đạt được bằng cách nâng cấp các hệ thống hoặc giá đỡ đơn lẻ (ví dụ: tăng số lượng GPU hoặc nâng cao hiệu suất-thiết bị đơn lẻ), nhưng bị hạn chế bởi trần công suất từ cơ sở hạ tầng như làm mát bằng nước. Các trung tâm dữ liệu hiện tại có ngưỡng vật lý cho nguồn điện đầu vào và tản nhiệt, ngăn chặn sự gia tăng vô hạn về mật độ tính toán trên mỗi giá đỡ hoặc trung tâm dữ liệu.

Giới hạn về quy mô{0}}Out: Mở rộng bằng cách thêm giá đỡ và máy chủ vào các cụm quy mô, nhưng bị giới hạn bởi không gian vật lý ở một địa điểm duy nhất, áp đặt giới hạn cứng đối với công suất thiết bị.

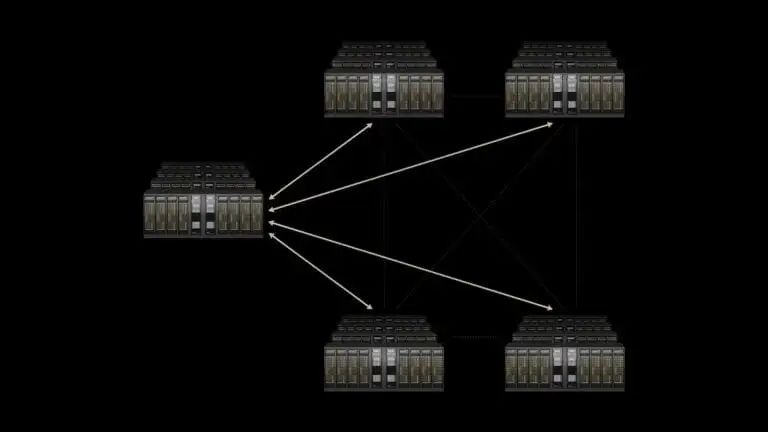

Để khắc phục tình trạng khó xử này, NVIDIA đề xuất chiều hướng mới về "mở rộng quy mô{0}}trên toàn bộ", tối ưu hóa giao tiếp mạng giữa các trung tâm dữ liệu phân tán về mặt địa lý để làm cho các cụm AI phân tán cộng tác thành một. Người sáng lập và Giám đốc điều hành NVIDIA Jensen Huang mô tả siêu nhà máy AI xuyên khu vực-này là cơ sở hạ tầng quan trọng cho cuộc cách mạng công nghiệp AI, với Spectrum-XGS là công cụ hỗ trợ công nghệ cốt lõi.

Công nghệ cốt lõi của quang phổ-XGS

Spectrum-XGS không phải là một nền tảng phần cứng hoàn toàn mới mà là sự phát triển của hệ sinh thái Spectrum-X Ethernet hiện có của NVIDIA. Kể từ khi ra mắt vào năm 2024, Spectrum-X đã mang lại hiệu suất mạng AI tổng hợp cao hơn 1,6 lần so với Ethernet truyền thống thông qua bộ chuyển mạch SN5600 của kiến trúc Spectrum-4 và DPU BlueField{11}}3, trở thành lựa chọn phổ biến cho các trung tâm dữ liệu AI sử dụng GPU NVIDIA. Bước đột phá trong Spectrum-XGS nằm ở ba cải tiến về thuật toán và sự phối hợp phần cứng nhằm giải quyết các thách thức về độ trễ truyền thông, tắc nghẽn và đồng bộ hóa trong các cụm GPU xuyên khu vực.

1.Thuật toán cốt lõi: Thích ứng động với các đặc điểm mạng khoảng cách xa-

Cốt lõi của Spectrum-XGS là một tập hợp các "thuật toán tối ưu hóa mạng nhận biết khoảng cách" phân tích các tham số chính của liên lạc giữa-dữ liệu-trung tâm trong-thời gian thực (khoảng cách, mô hình giao thông, mức độ tắc nghẽn, chỉ số hiệu suất) và tự động điều chỉnh các chính sách mạng:

Khoảng cách-Kiểm soát tắc nghẽn thích ứng:Không giống như cách xử lý thống nhất của Ethernet truyền thống cho tất cả các kết nối, thuật toán Spectrum-XGS tự động điều chỉnh ngưỡng tắc nghẽn dựa trên khoảng cách thực tế giữa các trung tâm dữ liệu (hiện hỗ trợ triển khai lên tới hàng trăm km), tránh mất gói hoặc tích tụ trong quá trình truyền khoảng cách-dài.

Quản lý độ trễ chính xác:Thông qua định tuyến thích ứng chi tiết theo-gói{1}}, nó giúp loại bỏ hiện tượng biến động độ trễ do truyền lại gói trong mạng truyền thống. Jitter là một mối nguy hiểm nghiêm trọng trong các cụm AI: nếu một GPU bị chậm do trễ thì tất cả các GPU cộng tác đều phải chờ, ảnh hưởng trực tiếp đến hiệu suất tổng thể.

Kết thúc-đến-Kết thúc đo từ xa: Việc thu thập-theo thời gian thực của dữ liệu hiệu suất liên kết-toàn bộ từ GPU đến bộ chuyển mạch và các liên kết trung tâm-dữ liệu-chéo cung cấp phản hồi ở cấp độ mili giây-để điều chỉnh thuật toán, đảm bảo khớp trạng thái mạng linh hoạt với nhu cầu khối lượng công việc AI.

2. Sự phối hợp phần cứng: Tận dụng phổ tần-Nền tảng băng thông cao-của Hệ sinh thái X

Spectrum-XGS đạt được hiệu suất tối ưu khi kết hợp với phần cứng NVIDIA cụ thể:

Công tắc quang phổ-X: Là đường trục mạng cơ bản, cung cấp mật độ cổng cao và khả năng chuyển tiếp có độ trễ-thấp.

ConnectX-8 SuperNIC: Bộ điều hợp mạng chuyên dụng AI{1}}800 Gb/s để truyền dữ liệu tốc độ cao giữa GPU và bộ chuyển mạch.

Phần cứng kiến trúc Blackwell: Chẳng hạn như GPU B200 và siêu chip GB10, được tích hợp sâu với Spectrum-XGS để giảm độ trễ-đến-cuối. NVIDIA đã xác thực thông qua các điểm chuẩn NCCL (thư viện truyền thông tập thể): Spectrum-XGS tăng hiệu suất giao tiếp giữa các-dữ liệu-trung tâm GPU lên 1,9 lần trong khi kiểm soát độ trễ từ đầu đến cuối-đến{11}}ở khoảng 200 mili giây-một mức độ mang lại cảm giác phản hồi nhanh và không bị lag khi tương tác với người dùng, đáp ứng các yêu cầu về thời gian thực cho hoạt động suy luận AI.

-Tối ưu hóa ngăn xếp đầy đủ để đào tạo AI và hiệu quả suy luận với Spectrum-XGS

Spectrum-XGS không phải là một công nghệ biệt lập mà là một phần bổ sung quan trọng cho hệ sinh thái AI-toàn diện của NVIDIA. Trong bản phát hành này, NVIDIA cũng tiết lộ các cải tiến về hiệu suất ở cấp độ phần mềm-kết hợp với Spectrum-XGS để cộng tác với phần cứng-thuật toán{6}}phần mềm:

Nâng cấp phần mềm Dynamo: Được tối ưu hóa cho kiến trúc Blackwell (ví dụ: hệ thống B200) để tăng hiệu suất suy luận mô hình AI lên tới 4 lần, giảm đáng kể mức tiêu thụ điện toán cho suy luận mô hình lớn.

Công nghệ giải mã suy đoán: Sử dụng một mô hình dự thảo nhỏ để dự đoán trước mã thông báo đầu ra tiếp theo của mô hình AI chính, giảm khả năng tính toán của mô hình chính và nâng cao hiệu suất suy luận thêm 35%. Điều này đặc biệt phù hợp với các kịch bản suy luận hội thoại trong các mô hình ngôn ngữ lớn (LLM).

Giám đốc bộ phận điện toán tăng tốc của NVIDIA, Dave Salvator, cho biết mục tiêu cốt lõi của những tối ưu hóa này là mở rộng quy mô các ứng dụng AI tác nhân đầy tham vọng. Cho dù đào tạo các mô hình lớn có hàng nghìn tỷ{1}}tham số hay hỗ trợ dịch vụ suy luận AI cho hàng triệu người dùng đồng thời, sự kết hợp giữa Spectrum-XGS và hệ sinh thái phần mềm đều mang lại hiệu suất có thể dự đoán được.

Các ứng dụng ban đầu và tác động của phổ tần đến ngành-XGS

Người dùng đầu tiên: CoreWeave Pioneers Cross{0}}Siêu nhà máy AI miềnNhà cung cấp dịch vụ đám mây GPU CoreWeave là một trong những đơn vị đầu tiên áp dụng Spectrum-XGS. Người đồng sáng lập và CTO Peter Salanki của công ty lưu ý rằng công nghệ này sẽ cho phép khách hàng tiếp cận các khả năng AI quy mô lớn, thúc đẩy những đột phá trong các ngành. Ví dụ: hỗ trợ các dự án AI có quy mô cực kỳ{5}}lớn{6}}như sáng kiến Stargate của Oracle, SoftBank và OpenAI.

Xu hướng của ngành: Ethernet thay thế InfiniBand làm mạng AI chính thốngMặc dù InfiniBand nắm giữ khoảng 80% thị trường mạng phụ trợ AI vào năm 2023, ngành này đang nhanh chóng chuyển sang Ethernet. Lựa chọn của NVIDIA để phát triển Spectrum-XGS trên Ethernet phù hợp với xu hướng này:

Ưu điểm về khả năng tương thích và chi phí:Ethernet là tiêu chuẩn chung cho các trung tâm dữ liệu toàn cầu, quen thuộc hơn với các kỹ sư mạng và chi phí triển khai rẻ hơn InfiniBand.

Dự báo quy mô thị trường:Dữ liệu của Tập đoàn Dell'Oro cho thấy thị trường chuyển mạch trung tâm dữ liệu Ethernet sẽ đạt gần 80 tỷ USD trong 5 năm tới.

Sự phát triển riêng của NVIDIA: Các báo cáo của 650 Group cho thấy NVIDIA là "nhà cung cấp-phát triển nhanh nhất" trong thị trường chuyển mạch trung tâm dữ liệu năm 2024, với doanh thu kinh doanh mạng đạt 5 tỷ USD trong quý2 2024 (kết thúc vào ngày 27 tháng 4), tăng 56% so với năm trước-so-năm.

Việc ra mắt Spectrum-XGS mở rộng chiến lược độc quyền toàn bộ-của NVIDIA trong cơ sở hạ tầng AI, đồng thời khơi dậy động lực cạnh tranh mới:

Bố cục ngăn xếp đầy đủ{0}}của NVIDIA: Từ GPU (Blackwell), kết nối liên thông (NVLink/NVLink Switch), mạng (Spectrum-X/Spectrum-XGS, Quantum-X InfiniBand) đến phần mềm (CUDA, TensorRT-LLM, NIM microservice), NVIDIA đã hình thành một hệ thống vi mô khép kín vòng lặp bao gồm "phần mềm-kết nối-điện toán" cho cơ sở hạ tầng AI. Spectrum-XGS phối hợp với NVLink để chia tỷ lệ ba cấp độ-: nội bộ-rack (NVLink), nội bộ-dữ liệu-trung tâm (Spectrum-X) và trung tâm-dữ liệu-chéo (Phổ-XGS).

Phản hồi của đối thủ cạnh tranh: Công nghệ SUE trước đây của Broadcom có chung mục tiêu với Spectrum-XGS, nhằm tối ưu hóa hiệu suất Ethernet để thu hẹp khoảng cách với InfiniBand. Ngoài ra, các nhà cung cấp như Arista, Cisco và Marvell đang tăng tốc các thiết bị chuyển mạch Ethernet chuyên dụng-AI, trong đó sự cạnh tranh tập trung vào khả năng tương thích hệ sinh thái-chi phí-hiệu suất.

Giá trị cốt lõi của Spectrum-XGS nằm ở việc thúc đẩy quy mô trung tâm dữ liệu AI từ "các ràng buộc-một địa điểm" sang "cộng tác xuyên{2}}khu vực". Khi năng lượng và đất đai trở thành giới hạn cứng đối với các trung tâm dữ liệu đơn lẻ, các siêu nhà máy AI xuyên{4}}thành phố và xuyên quốc gia sẽ trở thành hình thức cốt lõi hỗ trợ các ứng dụng AI thế hệ-tiếp theo (ví dụ: trí tuệ nhân tạo nói chung, cụm tác nhân quy mô-lớn).

Như phó chủ tịch cấp cao bộ phận mạng của NVIDIA, Gilad Shainer đã phát biểu tại hội nghị Hot Chips: "Các mạng vật lý cáp quang trung tâm-dữ liệu{1}} đã tồn tại từ lâu nhưng các thuật toán phần mềm như Spectrum-XGS là chìa khóa để mở khóa hiệu suất thực sự của các cơ sở hạ tầng vật lý này."